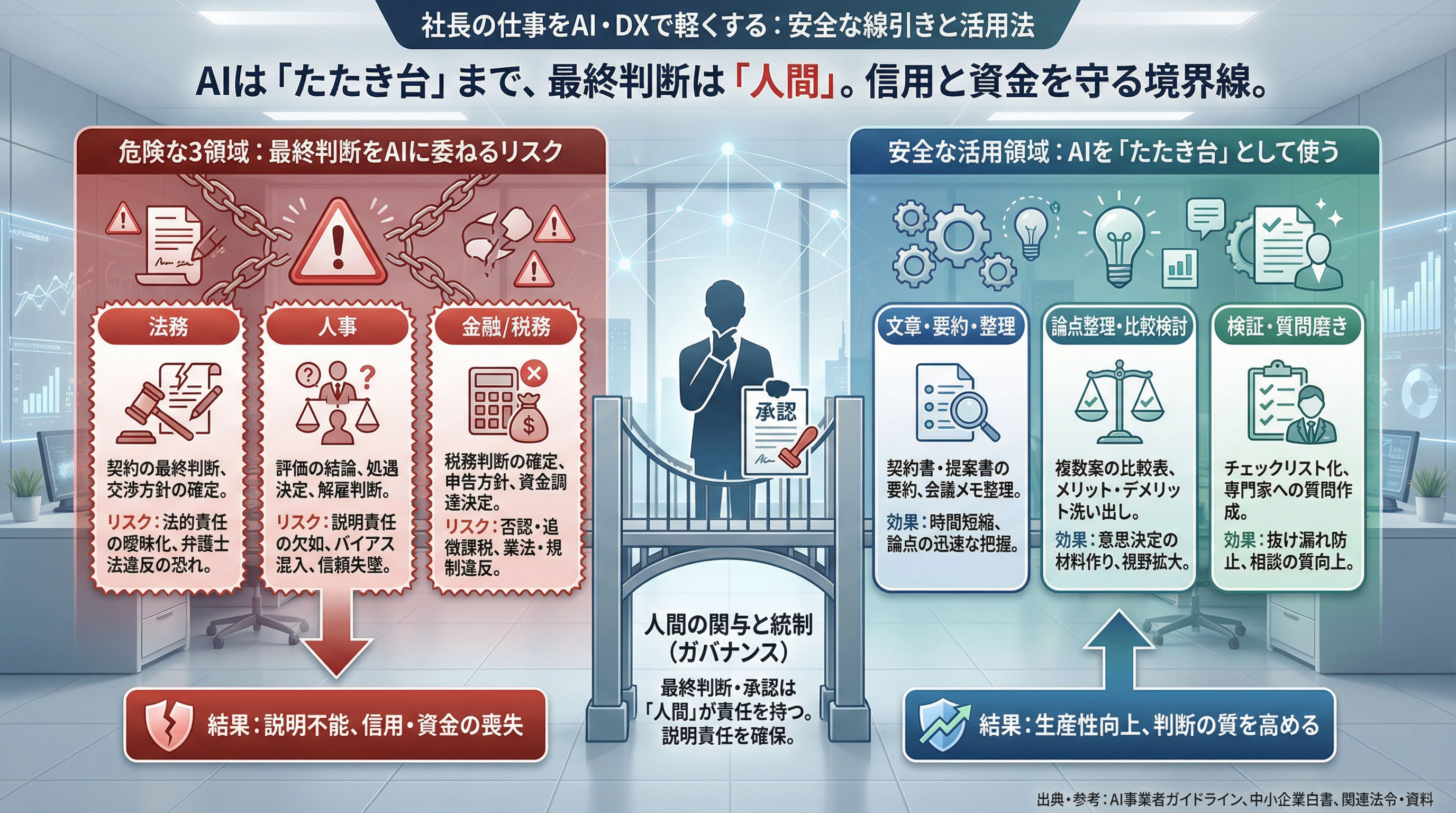

社長がAIに任せると危険なものと、安全に使う線引きの作り方【社長の仕事をAI・DXで軽くする26】

生成AIは、社長の仕事を軽くします。

しかし、任せ方を間違えると、会社の信用もお金も一気に失うかも知れません。

ポイントは単純で、AIは「たたき台」まで、最終判断は人間。

この線引きを、社内で言葉と運用に落とし込みましょう。

目次

「AIはたたき台まで」が経営に効く理由

生成AIは、文章をそれっぽくまとめたり、論点を並べたりするのが得意です。一方で、正しさを保証する装置ではありません。もっともらしい説明を作るのが上手いからこそ、判断を委ねると危ない領域が出てきます。

経済産業省と総務省の「AI事業者ガイドライン」は、利用分野に応じてリスクの大きさを見積もり、対策の強度を変える「リスクベースアプローチ」を重要としています。つまり、重大な意思決定ほど、人間の関与と統制を強くするのが筋でしょう。

社長として一番避けたいのは、「AIがそう言ったから」で決めてしまい、後から説明できなくなることではないでしょうか。取引先、社員、株主、金融機関。誰に対しても、最終判断の根拠は人間が語れる状態にしておく必要があります。

社長がAIに任せると危険な3領域(法務・人事・金融/税務)

ここからは、社長がAIに任せると危険な領域を、線引きができるように具体化します。結論はシンプルです。

| 領域 | AIに任せると危険な範囲 | AIに任せてよい範囲(たたき台) |

|---|---|---|

| 法務 | 契約の最終判断、交渉方針の確定、法的見解の断定 | 条文や論点の整理、質問リスト、相手案の要約、リスク項目の洗い出し |

| 人事 | 評価の結論、処遇決定、解雇や降格の判断 | 評価コメントの下書き、面談の質問設計、事実の時系列整理、制度の説明文作成 |

| 金融/税務 | 税務判断の確定、申告方針の決定、資金調達の最終判断 | 論点整理、必要資料のチェックリスト、数字の整形、金融機関向け説明のたたき台 |

では、なぜ危険なのか。理由は「AIが間違えることがある」だけではありません。責任の所在が曖昧になり、法律や規制の地雷を踏みやすいからです。

法務判断(契約の最終判断)をAIに任せる危険

契約は「文章」ですが、実態は「リスクと責任の配分」です。AIは文章を整えるのが得意なので、いかにも正しそうな条文を出してきます。しかし、取引背景、商慣習、相手の交渉姿勢、社内の許容リスクを理解しているわけではありません。

さらに、法務は資格制度と業規制の世界です。弁護士法第72条は、弁護士でない者が報酬を得る目的で法律事務を取り扱うことを禁止しています。社内利用の範囲でも、外部に提供するサービス設計や運用を誤ると、法的な論点になり得ます。

社内での実務として危ないのは、たとえば次のパターンです。

- AIが作った契約条文を、そのまま相手に送ってしまう

- AIの出力を根拠に、値引きや責任制限の交渉方針を固めてしまう

- 「この条項は問題ない」とAIが断定したから承認した、という状態になる

ここで社長に一つ質問です。その契約で事故が起きた時、誰が、どんな言葉で説明しますか。AIの出力を根拠にすると、説明が薄くなり、責任の線も曖昧になりがちです。

人事評価の結論をAIに委ねる危うさ

人事評価は、給与、昇格、配置、時には退職にも影響します。つまり、社員の人生に直結する意思決定です。ここをAIに「結論まで」やらせると、二つの問題が起きやすいでしょう。

- 説明責任が弱くなる(なぜその評価かを、納得感ある言葉で語れない)

- 評価の偏りが混入しやすい(入力データの偏り、評価者コメントの癖、過去の慣行のコピー)

会社あるあるで言えば、「評価シートのコメント欄が、毎回似た表現になる」問題があります。そこをAIで補うのは便利です。けれど、便利だからといって、AIに点数や結論まで出させたらどうなるでしょう。本人から「根拠を出してください」と言われた瞬間に詰むかも知れません。

安全な線引きは、AIは文章整形と論点整理まで。評価の事実認定と結論は、面談と現場観察を含めて人が持つ。これが現実的です。

金融/税務の確定判断をAIに置くリスク

税務や金融は、制度改正があり、個別事情で結論が変わります。AIは一般論の説明は得意でも、あなたの会社の契約、証憑、取引実態、税務調査の論点まで正確に把握しているわけではありません。

税務については、税理士制度のもとで業務が整理されています。国税庁も税理士制度や違反行為に関する情報を公開しています。結論として、社内でAIを使うとしても、申告や確定判断をAIの出力で固めるのは危険です。

出典:税理士法(e-Gov法令検索)、国税庁:税理士法違反行為(Q&A)

また、資金繰りや投資判断の領域では、外部向けに助言や情報提供を行う場合、登録や規制の論点が絡むことがあります。とくに「個別銘柄の推奨」や「投資判断への助言」に踏み込む設計は、線引きが必要でしょう。

AIが強い「安全領域」:たたき台・整理・検証の使い方

危険領域がある一方で、AIが刺さる領域もあります。むしろ、社長の仕事を軽くするのはここです。要は「結論」ではなく「準備」をAIに任せること。

文章、要約、論点整理は最短で効く

社長の時間を奪うのは、実は「判断そのもの」より、判断に至るまでの材料づくりです。例えば、次のような用途は効果が出やすいでしょう。

- 契約書や提案書の要約(何が変わったか、どこが危ないか)

- 会議メモの整理(決定事項、宿題、期限、担当)

- 複数案の比較表づくり(メリット、デメリット、前提条件)

会社あるあるで言えば、「会議のあと、議事録担当の押し付け合い」が起きがちです。ここはAIで一気に軽くなります。議事録が早く出れば、現場の手戻りも減るでしょう。

チェックリスト化は強いが、最後は人が見る

AIはルールを渡すと、チェック項目に分解するのが得意です。たとえば、契約レビューの観点、採用面接の確認観点、税理士に渡す資料の不足確認など、抜け漏れを減らす用途は強いです。

ただし、チェック結果の「合否判定」までAIにやらせると危険が戻ってきます。AIはそれっぽい理由を付けるので、現場が鵜呑みにしやすいからです。最後の確認は人がやる。この一手間が事故を防ぎます。

専門家に渡す前の「質問磨き」が価値を生む

法務なら弁護士、税務なら税理士。専門家に相談する時、社長の悩みは「何を聞けばいいか分からない」になりがちです。AIはここで力を発揮します。

- 前提条件を整理する

- 論点候補を列挙する

- 質問リストに変換する

この段階までAIにやらせると、専門家の時間が「説明」から「判断」に使われます。相談の質が上がるので、結果的に費用対効果も良くなるかも知れません。

社内で線引きを共有する方法(ルールとワークフロー)

一番大事なのは、社長の頭の中にある線引きを、社内の運用に落とすことです。口頭だけだと、現場は迷います。迷うと、人は自己流で使い始めます。そこが事故の入口でしょう。

3点セット:入力禁止、出力の扱い、承認フロー

まずは、これだけ決めると現場が動きます。

- 入力禁止:個人情報、機密情報、未公開の取引条件など、入力してはいけないもの

- 出力の扱い:AI出力は「参考資料」。そのまま外部送付禁止、などのルール

- 承認フロー:法務、人事、税務など領域ごとに、最終承認者を固定

個人情報の取り扱いについて、個人情報保護委員会は生成AIサービス利用時の注意喚起を行っています。社内ルールを作るなら、この観点は避けて通れません。

出典:個人情報保護委員会:生成AIサービスの利用に関する注意喚起(2023年6月2日)

責任の所在を固定する:RACIとログ

AIを入れると、責任がぼやけやすいです。「誰が見たのか」「誰が承認したのか」が残らない運用は危ないでしょう。おすすめは、難しい仕組みではなく、責任の役割を決めることです。

- 実行担当(作る人)R:Responsible

- 承認担当(最終判断する人)A:Accountable

- 相談先(法務、税務、人事など)C:Consulted

- 共有先(関係者)I:Informed

そして、AIを使った場合は「使った」事実と、最終判断者をメモで残す。ログがあれば、後から原因分析ができ、再発防止になります。

会社あるあるで起きる事故と回避策

現場で起きがちな事故を、先回りで潰します。

- 事故例:AIが作ったメールをそのまま顧客へ送付し、契約条件が誤って伝わる

回避策:外部送信は「人の最終確認」を必須にする。テンプレを作って確認観点を固定する - 事故例:評価コメントをAIが整えた結果、本人が「テンプレ評価」と受け取って不信感が増す

回避策:事実の具体例を必ず入れるルールにする。面談メモと紐付ける - 事故例:税務の扱いをAIに聞いて「大丈夫」と判断し、後から否認される

回避策:結論は税理士へ。AIは論点整理と必要資料のリスト化までに止める

ここで二つ目の質問です。社内の誰かが、すでにAIの出力を「結論」として扱っていませんか。もし心当たりがあるなら、ルール化は早い方が安全です。

国内の中小企業でも進んでいる:DXと生成AIの成功例

「うちは中小だから無理」と感じる社長ほど、事例が効きます。重要なのは、派手なAI開発ではなく、現場の詰まりをほどく設計です。

中小企業白書の事例:グランド印刷(福岡県)

中小企業庁の白書では、福岡県北九州市のグランド印刷株式会社(従業員55名)が、帳票処理や情報共有の煩雑さを解消するためにデジタルツール導入と基幹システム開発に取り組み、環境変化に対応した事例が紹介されています。いきなりAIではなく、まず業務の詰まりを取り除いたのがポイントでしょう。

出典:中小企業白書2024 第7節DX(事例1-4-5:グランド印刷)

DXセレクション2025の企業に学ぶ共通点

経済産業省の「DXセレクション2025」では、中堅・中小企業等の優良事例が選定されています。建設、製造、サービスなど業種はさまざまですが、共通しているのは「社長が意思決定の型を作り、現場の成功体験を積み上げた」ことです。

出典:経済産業省:DXセレクション2025、中堅・中小企業等向けDX推進の手引き2025(DXセレクション2025選定企業レポート)

派手な言葉より、地味な効き目。紙の稟議を減らす、情報共有を早くする、二重入力を止める。ここが先に整うと、生成AIの効果も出やすいです。

生成AIの現実:東京商工会議所の調査データ

「みんな使っている」と見える一方で、中小企業ではまだ過渡期です。東京商工会議所の調査では、生成AIを「活用している」企業の割合は11.7%、「今後活用を検討している」は33.5%とされています。つまり、社内で線引きを整えた会社が、先に前へ出られる状況でしょう。

出典:東京商工会議所:中小企業のための「生成AI」活用入門ガイド(第4版)

社長が最後に握るべき判断軸:説明できるか、責任を取れるか

損害が出た時に「誰が」説明するのか

最終判断をAIに寄せると、事故のときに責任が空中に浮きます。「AIがそう言った」は免罪符になりません。社長が守るべき軸は、説明可能性です。説明できない判断は、社内外の信頼を削ります。

AIガバナンスは難解ではなく、経営の基本

ガバナンスと聞くと大げさですが、やることは経営の基本です。

- どの領域をAIに触らせるか、触らせないか

- 誰が最終判断するか

- 入力と出力をどう管理するか

これだけで、AIは「事故の種」ではなく「生産性の武器」になります。

結論:AIで軽くしていい仕事、軽くしてはいけない仕事

最後に、社内共有用の一文に落とします。

AIはたたき台まで。最終判断は人間。

法務判断(契約の最終判断)、人事評価の結論、金融/税務の確定判断は、必ず人が責任を持つ。

AIは、要約、論点整理、チェックリスト化、質問作成、文章の下書きに使う。

三つ目の質問です。この一文を、あなたの会社の誰が読んでも同じ解釈になりますか? もし曖昧なら、業務ごとの禁止事項と承認者まで書いた「線引き表」にして配布すると、現場は迷わずにすむでしょう。

出典・参考

- AI事業者ガイドライン(総務省・経済産業省)

- 個人情報保護委員会:生成AIサービスの利用に関する注意喚起(2023年6月2日)

- 弁護士法(e-Gov法令検索)

- 税理士法(e-Gov法令検索)

- 国税庁:税理士法違反行為(Q&A)

- 関東財務局:投資助言・代理業(登録案内)

- 東京商工会議所:中小企業のための「生成AI」活用入門ガイド

- 中小企業白書2024 第7節DX(事例)

- 経済産業省:DXセレクション2025

- 中堅・中小企業等向けDX推進の手引き2025

▼このブログ記事の内容を図解したインフォグラフィックスです(スマホはピンチアウト操作で拡大表示できます)